来源:小编 更新:2025-02-27 02:28:05

用手机看

视频交互游戏:你的指尖舞动,世界随之改变

想象你正坐在一个充满魔力的世界里,只需轻轻一挥手指,就能让这个虚拟世界为你起舞。这就是视频交互游戏带来的奇妙体验,它不仅改变了我们与游戏互动的方式,更让我们的指尖舞动成为改变世界的魔法。

还记得2011年那款名为《Crows Coming》的iOS体感交互游戏吗?它可是iOS平台上的首款体感交互游戏,通过摄像头捕捉你的肢体动作,让你在游戏中操控虚拟物体。这种通过现实中的肢体动作来操控游戏的方式,就是体感交互的魅力所在。

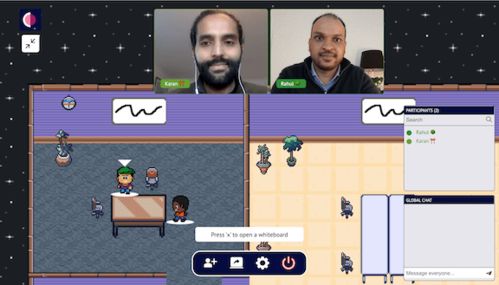

体感交互技术最早流行于微软的Kinect设备上,它通过摄像头捕捉玩家的动作,让玩家在游戏中实现更加直观和自然的交互。如今,这种技术已经广泛应用于各种视频交互游戏中,让玩家在游戏中体验到前所未有的沉浸感。

想要自己动手打造一个体感游戏世界吗?那就试试Unity 3D吧!这本书《Unity 3D体感交互游戏开发》为你提供了详细的教程和案例,让你轻松上手。

书中详细介绍了Unity 3D引擎在体感交互游戏开发中的应用,从基本的人机交互界面创建,到虚拟环境中的碰撞检测、视觉交互和声音可视化,再到简单的人工智能应用,全方位讲解了体感交互游戏开发的各个环节。

你是否想过,只需一张草图,就能直接生成一个可控制动作的视频游戏?谷歌的DeepMind团队就实现了这个梦想。他们推出的Generative Interactive Environments(简称Genie)模型,可以根据图像、真实照片甚至草图,生成各种可控制动作的视频游戏。

Genie模型使用了3万小时、6800万段的游戏视频进行了大规模训练,无需任何真实动作或其他特定提示,就能根据帧级别的信息,让用户在生成的环境中进行各种动作控制。

如果你对三维姿态估计和虚拟现实交互感兴趣,那么这篇《Python 三维姿态估计+Unity3d 实现 3D 虚拟现实交互游戏》的文章一定会让你眼前一亮。

文章介绍了如何使用Python和Unity3d实现一个基于ThreeDPoseUnityBarracuda的3D虚拟现实交互游戏。通过结合Python三维姿态估计模型和Unity3d引擎,实时获取人体三维坐标,然后将坐标与人体模型骨骼绑定,从而控制3D角色。

想要深入学习Unity 3D体感交互游戏开发吗?那就来看看《Unity 3D体感交互游戏开发教与学》吧!这本书以OBE-TC为主体,围绕人机交互技术中的三个层级:人机交互关键技术、人机交互与虚拟环境、人机交互产品设计开发进行讲解。

书中不仅介绍了最新的可穿戴设备的应用,还从交互式计算系统进行设计、评估和实现,并对其所涉及的主要现象进行研究。通过学习这本书,你将能够结合Unity3d引擎技术,应用相关的体感交互设备进行交互系统和互动装置的设计开发。

视频交互游戏,让我们的指尖舞动成为改变世界的魔法。从体感交互到Unity 3D引擎,再到谷歌的Genie模型,再到Python与Unity3D的结合,视频交互游戏的世界正变得越来越丰富多彩。让我们一起,用指尖舞动,探索这个充满无限可能的虚拟世界吧!